Il y a tout juste un an, le 18 novembre 2012, sortait la Wii U dans la zone nord américaine, la console est ensuite arrivée le 30 novembre en Europe, puis le 8 décembre au Japon.

Cet anniversaire est l’occasion de faire un premier petit bilan.

Avec un hardware en retard techniquement par rapport à ce qu’on serait en droit d’attendre en 2012, Nintendo continue sur sa lancée en proposant une alternative aux consoles dites « classiques » et au PC, en visant un public plus large de joueurs occasionnels, jeunes ou non, et en offrant toujours des jeux à la communauté de fidèles fans de la marques.

L’idée de Nintendo est de dire aux 100 millions d’acheteurs de la Wii : Maintenant, vous pouvez passer sur Wii U, la console est HD, tout les accessoires que vous avez sont compatibles, et en plus on vous rajoute le Gamepad qui permettra tout un tas de nouvelles possibilités !

Malheureusement, plusieurs erreurs importantes ont été commises dès le départ, les ventes n’ont pas été à la hauteur, et les gros titres se font encore attendre…

Communication Breakdown

Lors de la première présentation de ce qu’on appelait encore « le projet café », le gamepad étant mis en avant mais à aucune moment la console n’était clairement au premier plan, il fallait bien observer les vidéos pour l’apercevoir rapidement à côté d’une télévision.

Les commentaires sur les réseaux sociaux ou les forums évoquaient alors « un nouvel accessoire », et puis certains ont quand même fini par comprendre qu’il s’agissait bien d’une nouvelle console en voyant des images de jeux.

Si la confusion vient dans une premier temps de la présentation, elle vient également du choix du nom.

Je vois bien un type en costume expliquer avec des tas d’arguments tout à fait recevables le pourquoi du choix d’un tel nom, mais dans une logique de nommage claire pour le consommateur, Wii 2 c’était moins chiadé, mais ça serait plus facilement passé.

La plupart des vendeurs de jeux se sont rapidement heurtés à des joueurs occasionnels, ou des parents complètement perdus pensant qu’il s’agissait d’un nouvel accessoire, et encore aujourd’hui il leur arrive d’avoir à expliquer ce qu’est vraiment la Wii U.

Un nom plus clair, et un stand montrant bien la machine et le gamepad pendant la première présentation aurait surement facilité les choses.

Le Gamepad confortable, mais pas indispensable

Le gamepad apporte tout un tas de possibilités, parfois ce sont des idées de gameplay plus ou moins intéressantes, parfois il ne s’agit que d’un peu de confort de jeu.

On parlait beaucoup de gameplay asymétrique au départ, et finalement ça n’est pas beaucoup exploité en dehors des party games, je souhaiterais vraiment voir un peu plus de jeux se pencher sur ces possibilités et pousser vraiment les idées de gameplay, avec du FPS et STR mélangé, avec des modes en lignes, je ne crois pas forcément Nintendo capable de proposer de telles choses, mais je me demande si ça intéresse les autres éditeurs également…

Le Gamepad peut-être aussi utilisé comme un deuxième écran de jeu, comme une Nintendo DS de salon par exemple. Il deviendra un radar, un viseur, vous permettra de fouiller un environnement en sortant de l’écran TV, etc.

Dans Sonic & All Star Racing Transformed, le gamepad peut servir pour un cinquième joueur en plus des quatre autres qui seront en écran splitté sur la TV.

C’est également assez pratique comme deuxième écran pour gérer le menu pause par exemple, ça évite d’appuyer sur le bouton START. Dans un Zelda pour parler d’un jeu qu’une majorité d’entre vous connait, on a le plan, les objets, et on gère tout ça facilement, c’est clairement pas indispensable, mais bien pratique.

On voit déjà les autres constructeurs proposer quelque chose dans cet esprit, que ce soit la PS Vita chez Sony, ou Smartglass avec les tablettes et Smartphones Windows 8 ou Android pour Microsoft.

Avec la Wii U, le gamepad est d’office avec la console, un jeu peut utiliser l’accessoire puisque tous les joueurs l’ont.

Pour les concurrents, il faudra un accessoire supplémentaire, alors dans le cas de Smartglass on sait que beaucoup d’utilisateurs ont un Smartphone, mais pour Sony, il va falloir vendre des PS Vita… Ce n’est pas dit que les éditeurs suivent tous en proposant de vrais possibilités de jeux sur un deuxième écran, on peut donc s’attendre à très peu de prises de risques, et à pas mal de fonctionnalités gadget…

Dernier point pour les jeux au gameplay dit classique, il y a la possibilité de pouvoir jouer directement sur le Gamepad et de ne plus occuper l’écran de TV. Cela évite pas mal de conflits dans le salon, et même pour un célibataire fan de foot, ça permet de continuer à jouer tout en laissant le match sur la télévision. C’est quelque chose que j’ai rapidement appris à apprécier, et qui m’a probablement permis de finir plus rapidement certains jeux, et puisqu’on parlait de concurrence juste au dessus, j’espère retrouver cette feature avec la PS4 et la Xbox One !

Les jeux Nintendo se font attendre

Quand on se demande si on doit acheter une console Nintendo, c’est généralement parce qu’on aime les jeux Nintendo, que ce soit les jeux de l’univers Mario et notamment Mario Kart, ou Zelda par exemple. De ce point de vue là, Nintendo tente de faire son job, mais avec pas mal de difficultés…

La sortie de la console était accompagnée de New Super Mario Bros. U, suivi plusieurs mois plus tard d’une sorte de suite avec New Super Luigi U. Les jeux sont bons, mais pour les fans de Mario qui venaient de finir New Super Mario Bros. 2 sur 3DS c’était un peu trop tôt, et avec la version Luigi, on pourrait craindre l’overdose !

Au niveau des autres grandes licences, nous n’aurons eu qu’un remake de The Legend of Zelda: The Wind Waker, certes réussi mais les fans de longue date attendent surtout un nouvel épisode.

On notera tout de même l’excellent Pikmin 3 dont je vous avais parlé, et que je vous recommande chaudement.

Nintendo a également sorti quelques party games, comme Nintendo Land avec une petit moitié de jeux intéressants, un Game & Wario rigolo mais pas particulièrement inspiré, et Wii Party U que je n’ai pas encore testé.

Dans la série des jeux qui vous font vous lever de votre canapé, il y a le remake HD de Wii Sport disponible en téléchargement, et Wii Fit U qui fait ressortir la balance board du placard.

Au final, à moins d’être un fan extrême de Mario qui se jette sur le moindre niveau supplémentaire, de Pikmin, ou de n’avoir jamais joué à The Wind Waker, il n’y a pas vraiment de killer app pour le moment.

Les jeux tiers exclusifs

Les éditeurs tiers et Nintendo, c’est une histoire bien compliquée. Si on regarde bien, sur Wii U, on a essentiellement Ubisoft, Activision, et Warner Bros Interactive qui ont sorti plusieurs jeux, mais pas forcément beaucoup d’exclusivités…

Ubisoft semblait vouloir faire confiance à Nintendo en proposant pour la sortie de la machine Zombi U, une exclusivité et une nouvelle licence qui plus est, mais devait penser que la console se vendrait autant que la Wii – ce qui était hautement improbable – et n’a surement pas rentabilisé son jeu qui pourtant n’est pas mal du tout.

Ensuite, alors que tout le monde l’attendait, il y a eu le report de Rayman Legends, ce qui d’après moi fut une très mauvaise idée. La perte d’exclusivité a moins donné envie aux joueurs d’acheter le jeu, c’est peut-être irrationnel mais c’est pourtant quelque chose que j’ai constaté en lisant quelques discussions sur différents forums. De plus la période choisie pour la sortie n’était franchement pas idéale, et le jeu n’a clairement pas eu les ventes qu’il méritait.

J’ai bien peur qu’Ubisoft ne fasse plus beaucoup d’effort pour proposer des jeux exclusifs sur Wii U, ce serait dommage, car la version de Rayman Legends Wii U est clairement la meilleure.

De son côté Sega a développé Sonic Lost World, qui n’est pas aussi bon qu’on l’espérait mais qui reste un Sonic 3D bien agréable je trouve, mais notez que le jeu est édité par Nintendo, tout comme Mario & Sonic aux Jeux Olympiques d’Hiver de Sotchi 2014, mais ça n’a rien d’étonnant vu que le jeu utilise leurs personnages…

Nintendo est également l’éditeur des jeux Platinum Game, comme le bien barré Wonderful 101, et Bayonetta 2 qui malgré les hurlements des fans désespérés ne sera donc pas une exclusivité temporaire comme je l’ai pensé au départ.

Je suis d’ailleurs assez impatient de tester le jeu, mais j’ai un peu peur qu’il ne se vende pas beaucoup, et je me demande ce que ce partenariat donnera sur le long terme si les jeux peinent à se vendre…

Comme on le voit, Nintendo se retrouve souvent à devoir éditer lui même certains jeux, c’est également le cas avec Monster Hunter Tri ou Lego City Undercover par exemple.

Beaucoup d’éditeurs se seront contentés de faire des portages jusqu’ici, et au final il y a assez peu de vraies exclusivités.

Cette situation ne devrait pas changer radicalement avant un moment. Le parc de consoles installées n’est pas très rassurant, vu qu’il dépasse à peine les 4 millions. Les éditeurs se sont habitués ces dernières années à sortir des jeux sur des machines bien en place, que ce soit la Wii avec ses 100 millions de machines vendues, ou les Xbox 360 et PS3 avec environ 80 millions chacune.

Yves Guillemot le PDG d’Ubisoft commentait clairement la situation de Nintendo en disant « Ils doivent en vendre plus », sous entendu « pour qu’on se remette à faire des jeux exclusifs dessus ». Quoi qu’il en soit, et même sans jeux exclusifs, Ubisoft reste assez lié à Nintendo, et plusieurs jeux sont encore prévus dessus.

De son côté, Nintendo continue son petit bonhomme de chemin, et explique qu’ils ne sortiront pas le chéquier pour acheter des portages de jeux, on peut les comprendre, je ne crois pas que les joueurs qui ont acheté leur Wii U ont fait l’impasse sur la PS3 et la Xbox 360, et de plus dans l’avenir, je ne pense pas que les portages vers une génération moins puissante de console soit très valorisant.

Quels jeux pour relancer la console ?

Avec seulement deux jeux dépassant le million de ventes dans le monde, Nintendo n’a pas encore vraiment de killer app, il faudra bien qu’elles arrivent, et on sait déjà qu’il y en a quelques unes en préparation.

On attend pour le 29 novembre Super Mario 3D World qu’on espère encore mieux que l’épisode 3DS, en 2014 on n’aura à priori des nouvelles de Mario Kart 8, de Super Smash Bros. U, de Donkey Kong Country : Tropical Freeze, d’un nouveau Zelda dont on a pas encore vu une seule image, et pourquoi pas un nouveau Métroid, même si on ne sait pas trop qui pourrait le développer.

Je n’arrête pas de le dire, mais j’aimerais vraiment un F-Zero, ne serait-ce qu’un remake de la version Gamecube en HD avec un mode Online, et puis pourquoi pas quelques circuits des précédents jeux pour les nostalgiques, malheureusement ça n’est pas au programme.

Dans les licences Nintendo qui marchent bien, on peut attendre un Fire Emblem, puisqu’il y a vraiment moyen de faire quelque chose de qualité avec le Gamepad, mais pour le moment pas de nouvelles.

Chez les tiers, dans les jeux attendus, il y a Bayonetta 2 dont je parlais juste avant, et ce qu’on appelle X ou le nouveau Xenoblade, qui devrait attirer un certain type de joueurs, mais sans faire exploser les compteurs, Xenoblade Chronicles ne s’était pas vendu à plus d’un million d’exemplaire malgré le parc installé de Wii…

Les jeux indépendant et dématérialisés sont aussi présent, il y a de la qualité, et Nintendo semble essayer de faire bouger son eShop, mais là encore ça ne va pas bien vite.

En résumé, les jeux arrivent, mais au compte goute, et en dehors de Mario Kart 8 on ne sait pas ce qui pourrait faire exploser les ventes.

C’est vrai, l’offre est vraiment limitée, mais rappelez vous la Wii s’était essentiellement vendue au départ pour Wii Sport.

Aujourd’hui, Nintendo propose une très grandes quantité de pack pour sa console, du premier pack premium avec Zombi U sorti au départ jusqu’au futur pack avec Wii Fit U et tous les accessoires nécessaires, il y en a presque tout le monde.

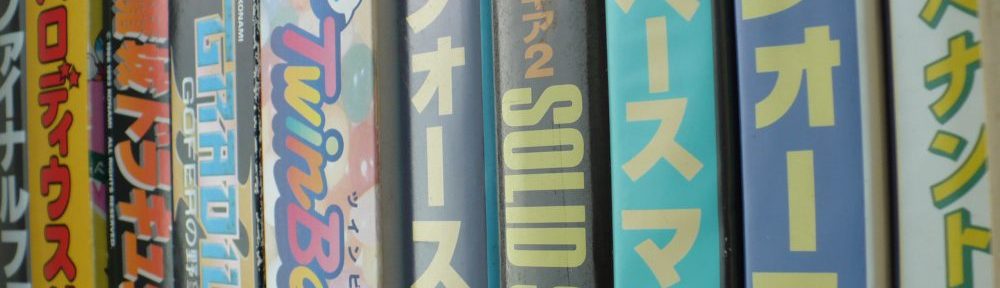

Quelques exemples de packs Wii U

Et il y a fort à parier que dès l’année prochaine on assistera à une baisse de prix, et que des packs complets sortiront.

La Wii U : Nouvelle Dreamcast ? Dernière console de Nintendo ?

Voila la comparaison régulièrement faite pour parler d’une console qui ne se vend pas, on nous sort la carte Dreamcast, c’est idiot, la comparaison n’a pas lieu d’être.

L’échec de la Dreamcast ne s’explique pas en quelques lignes, je reviendrais peut-être dessus un jour, mais Nintendo n’est clairement pas dans la même situation que Sega à l’époque.

La Wii U ne renouvellera pas l’exploit de la Wii, c’est évident, mais s’en sortira correctement malgré tout sur le long terme.

Nintendo a toujours été à part, particulièrement depuis la Nintendo 64, et a toujours réussi à résister. On annonçait leur mort avant même de commencer à envisager sérieusement celle de Sega à l’époque. Nintendo devait mourir avec la Nintendo 64, avec la Gamecube, et même après le démarrage fulgurant de la Wii certains disaient que ça dureraient pas…

Certains expliquent qu’ils vont arrêter les consoles de salon, parce qu’ils n’arriveront pas à suivre face à Sony et Microsoft, et d’autres en rajoutent en disant que même au niveau des portables ils ne tiendront pas face à la concurrence de l’iPhone, oubliant au passage qu’Android est largement majoritairement sur ce marché.

Je crois que les consoles vont de toute façon changer, les consoles de salons ne peuvent pas se contenter d’être des PC, et les consoles portables doivent faire face à la concurrence des tablettes ou des smartphones.

Sony l’a peut-être essayé trop tôt, et sans succès, mais je pense que Nintendo devrait s’intéresser à cette infographie, et se pencher sur la question sérieusement sur la possibilité d’une console pouvant servir de smartphone.

Et même sans aller dans ce sens, Nintendo a encore une image vraiment différente, les parents sont bien plus confiant lorsqu’ils achètent une DS ou une 3DS à leurs enfants qu’une PSP ou une PS Vita.

Leurs choix sur le online et notamment la possibilité ou non de discuter, peuvent paraitre étonnants, mais en tant que père, je suis rassuré de voir qu’ils font attention à ce que les enfants font avec leurs consoles de jeux. Et je sais que j’aurais bien plus de facilité à conseiller une console Nintendo à un enfant qu’une console concurrente, un PC, ou autre tablette tactile.

Alors, le bilan est positif ou négatif ?

Qu’on soit gamer, hater, ou fanboy, on est tous d’accord, le bilan est négatif.

La console ne se vend pas bien, en un an elle aura eu du mal à dépasser les 4 millions de ventes, et n’a que 2 jeux ayant dépassé le million de vente, Nintendo Land et New Super Mario Bros. U. A titre de comparaison, la Playstation 3 qui avait eu un départ assez difficile a terminé sa première année avec moins de 6 millions de consoles vendues, c’est plus mais pas tant que ça si on considère que c’est une console qui représentait une vraie nouvelle génération, par contre il y avait beaucoup de jeux prévus dessus, et l’avenir semblait bien plus prometteur, alors que les jeux attendus sur Wii U ne sont pas nombreux…

Pour les fans il n’y a pas assez de jeux, même si juste avant la date anniversaire en Europe nous auront Super Mario 3D World.

Et enfin, le Gamepad ne fait pas la différence comme a pu le faire la Wiimote en son temps, d’autant que la concurrence propose quelque chose d’équivalent, même si la facture sera évidemment plus salée…

Mais on n’est pas dans un cas ou on achète une console déjà morte, Nintendo a encore pas mal de cartes à jouer.

La Wii U a d’ors et déjà perdu la guerre de la « nouvelle génération », mais c’est une console qui va continuer à nous proposer de bons jeux pendant encore quelques années. Il faut espérer que Nintendo a déjà songé à une suite, car ils ne pourront pas capitaliser comme ils l’ont fait avec la Wii, il faudra un peu plus vite s’aligner techniquement avec la concurrence cette fois ci.

Si vous hésitez à l’acheter, c’est que vous n’avez pas assez de jeux qui vous tentent dessus, alors je vous conseillerais d’attendre la prochaine baisse de prix, qui interviendra surement après la sortie de Mario Kart 8, et là vous pourrez me balancer des carapaces dans la tronche en ligne, et ça ben ça met tout le monde d’accord.